Miksi sivuston on annettava vastaus 2,5 sekunnissa?

Yhteenveto

2,5 sekuntia latausaikana on muodostunut uudeksi standardiksi, jota tekoälyagentit ja kielimallit käyttävät arvioidessaan lähteiden luotettavuutta ja saavutettavuutta.

Tekoäly ei ainoastaan hae tietoa, vaan se prosessoi sitä reaaliajassa.

Tämä vaatii sivustolta:

Teknistä selkeyttä: "Headless"-selainten on pystyttävä lukemaan DOM-rakenne ja metatiedot viiveettä.

Optimoituja mittareita: Core Web Vitals -arvot (LCP, INP, CLS) toimivat suorina laatusignaaleina tekoälylle.

Strategista rakennetta: Siirtyminen perinteisestä SEO:sta AEO-malliin vaatii sisällön tiivistämistä ja rakenteellisen datan (Schema.org) täydellistä hallintaa.

Lopulta kyse on luottamuksesta ja tehokkuudesta.

Jos sivusto on hidas, se tulkitaan teknisesti vanhentuneeksi, jolloin arvokaskaan sisältö ei päädy tekoälyvastauksiin.

Nopeuden optimointi ei ole "vain IT-projekti", vaan keskeinen osa yrityksen markkinointistrategiaa ja konversioiden varmistamista.

Katso hakukoneoptimoinnin palvelumme tästä.

Miksi 2,5 sekuntia on uusi standardi tekoälyaikakaudella?

Verkkosivuston latausnopeus ei ole enää vain käyttäjäkokemusta parantava tekijä, vaan se on edellytys tekoälyn suorittamalle indeksoinnille. Tekoälyagentit ja kielimallit (LLM) arvottavat lähteitä niiden saavutettavuuden perusteella.

Jos palvelimesi viivästyy, tekoäly siirtyy seuraavaan lähteeseen sekunnin murto-osassa varmistaakseen oman vastauksensa nopeuden.

Tekoälyvastaukset toimivat ennennäkemättömällä nopeudella. Ne eivät ainoastaan hae tietoa, vaan ne prosessoivat sitä reaaliajassa. Kun käyttäjä esittää kysymyksen, tekoäly hakee useita lähteitä samanaikaisesti.

Tekoälylle 2,5 sekuntia on ikuisuus.

Nykyiset tekoälypohjaiset hakukoneet on ohjelmoitu maksimoimaan tehokkuus. Ne käyttävät resursseja vain sellaiseen sisältöön, joka on helposti ja nopeasti saatavilla. Hidas sivusto tulkitaan epäluotettavaksi tai teknisesti vanhentuneeksi.

Tämä johtaa siihen, että brändisi asiantuntemus jää pimentoon, vaikka sisältösi olisi maailman parasta.

LUE MYÖS: Miten suomalainen hakukoneoptimointiyritys voi tukea verkkosivujen teknistä auditointia?

Miten tekoälyagentit (AI Agents) selaavat verkkoa?

Tekoälyagentit käyttävät "headless" -selaimia ja API-rajapintoja kerätäkseen tietoa. Ne eivät odota raskaita grafiikoita tai monimutkaisia JavaScript-animaatioita.

Jos sivustosi DOM-rakenne ei ole selkeä ja nopeasti ladattavissa, tekoäly ei pysty poimimaan sieltä relevantteja faktoja vastaustaan varten.

Kun tekoäly vierailee sivustollasi, se tarkastelee ensisijaisesti tekstuaalista sisältöä ja metatietoja. Se arvioi sivun rakenteen välittömästi.

Jos palvelimen vasteaika (TTFB, Time to First Byte) on korkea, botti luokittelee sivun huonolaatuiseksi resurssiksi.

Tekoälylle on tärkeää löytää vastaus nopeasti, koska sen on yhdistettävä tietoa kymmenistä eri lähteistä sekunneissa. Jos yksi lähde jarruttaa, se jätetään välistä.

Tämä on kriittistä ymmärtää: tekoälyvastauksissa ei ole kymmentä sijaa kuten Googlen ensimmäisellä sivulla. Siellä on usein vain yksi tai kaksi lähdeviitettä.

Sivuston arkkitehtuurin on tuettava tätä nopeutta. Käytännössä tämä tarkoittaa:

Vähäistä koodin määrää suhteessa tekstiin.

Tehokasta välimuistitusta (caching).

Sisällönjakeluverkoston (CDN) hyödyntämistä maailmanlaajuisesti.

Rakenteellisen datan (Schema.org) virheetöntä käyttöä.

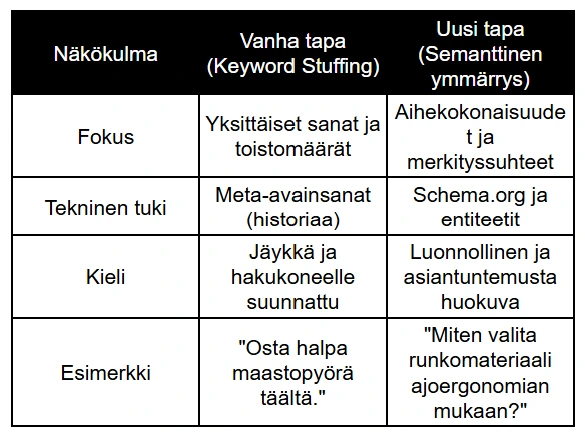

Mitä eroa on perinteisellä hakukoneoptimoinnilla ja vastauskoneoptimoinnilla (AEO)?

Perinteinen hakukoneoptimointi keskittyy sijoituksiin hakutulossivulla (SERP), kun taas AEO keskittyy olemaan se yksi ja ainoa vastaus.

AEO vaatii strategista muutosta sisällöntuotantoon: Jokaisen sivun tulisi alkaa tiivistelmällä, joka on optimoitu suoraan tekoälyn poimittavaksi.

Hakukoneoptimoinnissa voit pärjätä hieman hitaammallakin sivulla, jos auktoriteettisi on kova. Sen sijaan AEO:ssa tekninen hitaus on välitön hylkäysperuste.

LUE MYÖS: AI-optimointi opas 2026: Paranna näkyvyyttäsi hakukoneissa

Miten tekninen suorituskyky vaikuttaa suoraan sijoituksiin ja liiketoimintaan?

Sivuston nopeus on suorassa yhteydessä konversioprosenttiin ja näkyvyyteen. Jokainen sekunti laskee todennäköisyyttä onnistuneeseen vuorovaikutukseen, mikäli käyttäjä tai botti joutuvat odottamaan. Tekoälyaikakaudella tämä vaikutus vain moninkertaistuu, koska algoritmit suosivat tehokkuutta kaikessa.

Jos sivustosi latautuu 4 sekunnissa ideaalin 1 sekunnin sijaan, menetät laskennallisesti jopa 21 % konversioistasi pelkän odottelun vuoksi.

Tekoälyvastauksissa menetys on vieläkin rajumpi. Jos algoritmi havaitsee sivustosi hitaaksi, se laskee sivuston luotettavuuspisteitä. Luotettavuus on yksi tekoälyn tärkeimmistä kriteereistä lähteiden valinnassa.

LUE MYÖS: Nettisivujen optimointi: Näin teet sivustostasi kasvun moottorin

Nopeuden optimointi on siis suora investointi yrityksesi tulokseen. Se ei ole vain IT-osaston projekti, vaan keskeinen osa markkinointistrategiaa.

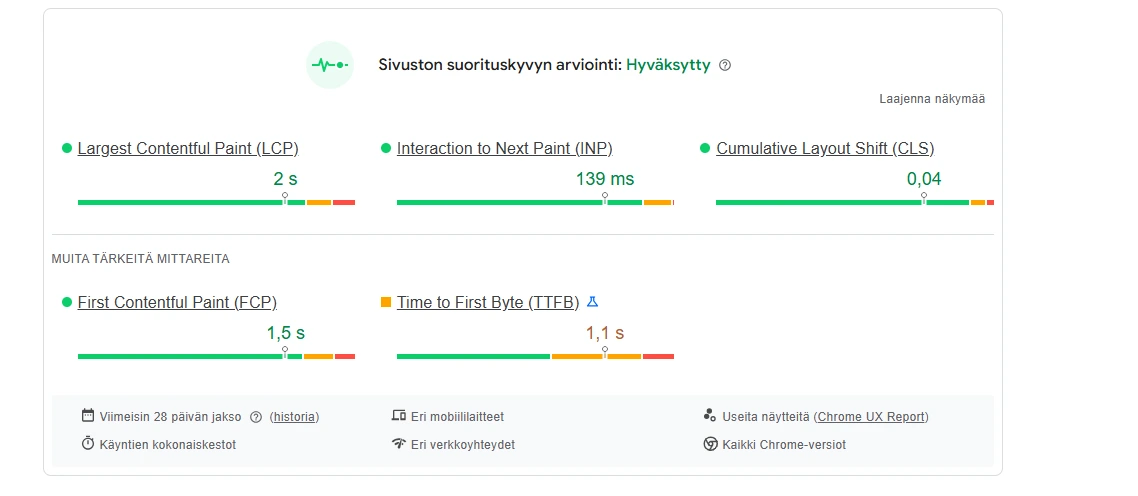

Miten Core Web Vitals vaikuttavat paikkaasi tekoälyvastauksissa?

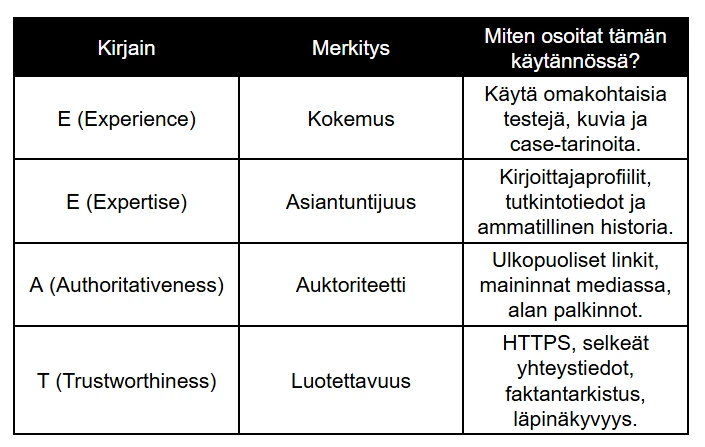

Core Web Vitals ovat Googlen ja muiden hakukoneiden tapa mitata todellista käyttäjäkokemusta teknisten mittarien kautta.

Tekoälyagentit suosivat sivustoja, jotka läpäisevät nämä testit, koska ne takaavat sisällön saavutettavuuden. Jos mittarisi ovat punaisella, tekoäly luokittelee sivustosi huonolaatuiseksi ja valitsee nopeamman vaihtoehdon lähteekseen sekunnin murto-osassa.

Tekoälyvastaukset eivät synny tyhjiössä. Ne nojaavat dataan, jonka "indeksointibotit" keräävät.

Core Web Vitals -mittarit kertovat näille boteille, onko sivustosi teknisesti kykenevä palvelemaan käyttäjää.

Jos sivustosi hyppii latautuessaan tai vastaa viiveellä, tekoäly päättelee, että käyttäjäkokemus on huono. Tämä laskee sivustosi auktoriteettia vastausgeneraattoreiden silmissä.

LUE MYÖS: Hakukoneoptimointi älypuhelimille: Miksi Se on strateginen elinehto?

Kolme kriittistä mittaria tekoälyn näkökulmasta:

LCP (Largest Contentful Paint): Tämä mittaa sivun pääsisällön latautumisnopeutta. Tekoälylle tämä on merkki siitä, kuinka nopeasti se saa tarvittavat faktat käsiteltäväksi.

Tavoittele arvoa: LCP ≤ 2,5 sINP (Interaction to Next Paint): Tämä uusi mittari korvasi FID:n ja se mittaa sivun vastenopeutta käyttäjän toimintoihin. Jos tekoälyagentti simuloi klikkausta ja sivusto "jäätyy", se on merkki huonosta koodista.

Tavoittele arvoa: INP ≤ 100 ms

CLS (Cumulative Layout Shift): Mittaa sivun visuaalista vakautta. Jos teksti liikkuu latauksen aikana, botit voivat lukea väärää tietoa väärästä paikasta.

Tavoittele arvoa: CLS ≤ 0.1 ms

Nämä arvot ovat suoria signaaleja tekoälylle siitä, että sivustosi on luotettava ja teknisesti ajan tasalla.

LÄHDE: Developers Google Understanding Core Web Vitals and Google search results

Kun CWV-arvot ovat vihreällä, nostat huomattavasti todennäköisyyttäsi päästä ensisijaiseksi lähteeksi ChatGPT- tai Gemini-hauissa.

Core Web Vitals arvot voit mitata, esimerkiksi Googlen PageSpeed Insights -työkalulla.

Mitä tapahtuu, jos Core Web Vitals -arvot epäonnistuvat?

Kun sivuston CWV-arvot ylittävät sallitut rajat, hakukoneen algoritmi alkaa suodattaa sivustoa pois parhaista hakutuloksista.

Sivuston optimointi näiden mittarien mukaiseksi vaatii usein koodin siivoamista, palvelimen tehon optimointia ja resurssien priorisointia. Se on kuitenkin ainoa tapa varmistaa, että tekoäly ei hylkää sivustoasi hitauden vuoksi.

Kuinka optimoit sivuston vastaamaan alle 2,5 sekunnissa?

Optimointi alkaa palvelintasolta ja ulottuu aina viimeiseen koodiriviin asti. Sinun on karsittava kaikki turha painolasti, joka hidastaa sivun renderöintiä.

Tekoäly arvostaa selkeyttä ja nopeutta, joten tekninen yksinkertaisuus on valttia.

LUE MYÖS: Mitä on nykyaikainen SEO-strategia?

Tässä ovat kriittisimmät askeleet:

Päivitä palvelinympäristö: Käytä HTTP/3-protokollaa ja varmista, että palvelimesi sijaitsee lähellä kohdeyleisöäsi.

Optimoi kuvat ja media: Käytä moderneja formaatteja, kuten WebP tai AVIF. Älä koskaan lataa suurempaa kuvaa kuin mitä näytetään.

Karsi JavaScript-viidakko: Viivästytä sellaisten skriptien latausta, jotka eivät ole kriittisiä sivun ensinäkymän (Above the Fold) kannalta.

Käytä tehokasta välimuistitusta: Staattisten resurssien tulisi latautua salamannopeasti suoraan selaimen tai CDN-verkon muistista.

Strukturoitu data: Varmista, että Schema.org-merkinnät ovat kunnossa. Tämä auttaa tekoälyä ymmärtämään sisältösi ilman, että sen tarvitsee "arvailla".

Kun sivustosi tekninen suorituskyky on huippuluokkaa, tekoälyagentit vierailevat siellä useammin. Mitä useammin ne vierailevat, sitä tuoreempaa tietoa niillä on yrityksestäsi.

Näin ollen sitä todennäköisemmin ne suosittelevat sinua vastauksissaan.

Katso hakukoneoptimoinnin palvelumme tästä.

Usein kysytyt kysymykset

1. Miksi 2,5 sekunnin latausaika on kriittinen tekoälyaikakaudella?

Tekoälyagentit ja kielimallit (LLM) arvottavat lähteitä niiden nopeuden ja saavutettavuuden perusteella. Jos sivusto latautuu hitaasti, tekoäly hylkää sen sekunnin murto-osassa ja siirtyy seuraavaan lähteeseen varmistaakseen oman vastauksensa nopeuden.

2,5 sekuntia on tekninen kynnysarvo, jonka ylittäminen voi jättää brändisi vaille tekoälyn huomiota.

2. Miten tekoälyagentit (AI Agents) eroavat tavallisista käyttäjistä sivustollasi?

Tekoälyagentit käyttävät tiedonhakuun "headless"-selaimia ja API-rajapintoja. Ne eivät välitä visuaalisista tehosteista tai animaatioista, vaan analysoivat välittömästi sivun DOM-rakennetta, tekstisisältöä ja metatietoja.

Niille tärkeintä on tiedon nopea poimittavuus ilman teknisiä esteitä.

3. Mitä on AEO ja miten se eroaa perinteisestä hakukoneoptimoinnista (SEO)?

Siinä missä perinteinen SEO tähtää korkeisiin sijoituksiin hakutulossivulla, AEO (Answer Engine Optimization) pyrkii olemaan se yksi ja ainoa vastaus, jonka tekoäly antaa käyttäjälle.

AEO-strategiassa tekninen nopeus on ehdoton vaatimus. Sen sisältö on jäsenneltävä niin, että tekoäly voi poimia vastauksen suoraan tekstin alusta.

4. Mikä on TTFB ja miksi se on tärkeä tekoälylle?

TTFB (Time to First Byte) tarkoittaa palvelimen vasteaikaa. Jos TTFB on korkea, tekoälybotti luokittelee sivun huonolaatuiseksi resurssiksi.

Koska tekoälyn on yhdistettävä tietoa kymmenistä lähteistä sekunneissa, hidas palvelin on sille pullonkaula. Tämä johtaa lähteen hylkäämiseen.

5. Miten sivuston hitaus vaikuttaa liiketoiminnan konversioihin?

Sivuston nopeus on suorassa suhteessa tuottoon. Jos sivusto latautuu esimerkiksi neljässä sekunnissa sekunnin sijaan, yritys voi menettää jopa 21 % konversioistaan.

Tekoälymaailmassa menetys on suurempi, sillä hidas sivu laskee sivuston luotettavuuspisteitä algoritmien silmissä.

6. Mitkä ovat kolme tärkeintä Core Web Vitals -mittaria tekoälyn kannalta?

LCP (Largest Contentful Paint): Pääsisällön latausnopeus (tavoite ≤ 2,5 s).

INP (Interaction to Next Paint): Sivun vastenopeus käyttäjän toimintoihin (tavoite ≤ 100 ms).

CLS (Cumulative Layout Shift): Sivun visuaalinen vakaus (tavoite ≤ 0.1).

7. Mitä tapahtuu, jos sivusto epäonnistuu Core Web Vitals -testeissä?

Jos mittarit näyttävät punaista, hakukoneet ja tekoälyagentit suodattavat sivuston pois ensisijaisista lähteistä.

Huonot arvot viestivät algoritmeille teknisestä vanhentuneisuudesta ja huonosta käyttäjäkokemuksesta, mikä laskee sivuston auktoriteettia.

8. Miten Schema.org-merkinnät auttavat tekoälyä?

Strukturoitu data (Schema.org) auttaa tekoälyä ymmärtämään sivun sisällön ja asiayhteyden ilman "arvailemista".

Virheetön rakenteellinen data nopeuttaa tiedon prosessointia ja parantaa mahdollisuuksia päästä ensisijaiseksi lähteeksi ChatGPT:n tai Geminin kaltaisissa palveluissa.

9. Mitkä ovat nopeimmat tavat optimoida sivusto alle 2,5 sekuntiin?

Kriittisimpiä toimenpiteitä ovat palvelinympäristön päivitys HTTP/3-protokollaan, kuvien optimointi moderneihin formaatteihin (WebP/AVIF), turhan JavaScriptin karsiminen sekä tehokkaan välimuistituksen ja maailmanlaajuisen CDN-verkoston hyödyntäminen.

10. Miksi tekninen suorituskyky on osa markkinointistrategiaa?

Tekoälyaikakaudella tekninen laatu on näkyvyyden edellytys. Vaikka yrityksellä olisi maailman paras sisältö, se voi jäädä pimentoon tekniikan vuoksi. Tekoälyagentit eivät pysty lukemaan sitä silloin nopeasti. Nopeuden optimointi on siis suora investointi brändin löydettävyyteen ja markkina-asemaan.